Seguridad en la conducción autónoma: ¿protección de pasajeros o de peatones?

El día en que nos convertimos Pasajeros habituales en coches autónomosOjalá que en el futuro hayamos llegado al punto en que se conviertan en máquinas muy conscientes capaces de... haciendo lo mejor que pueden Por el bien común. Se incorporarían educadamente y vigilarían a los peatones en el cruce, contribuyendo así a mantener la seguridad en las carreteras.

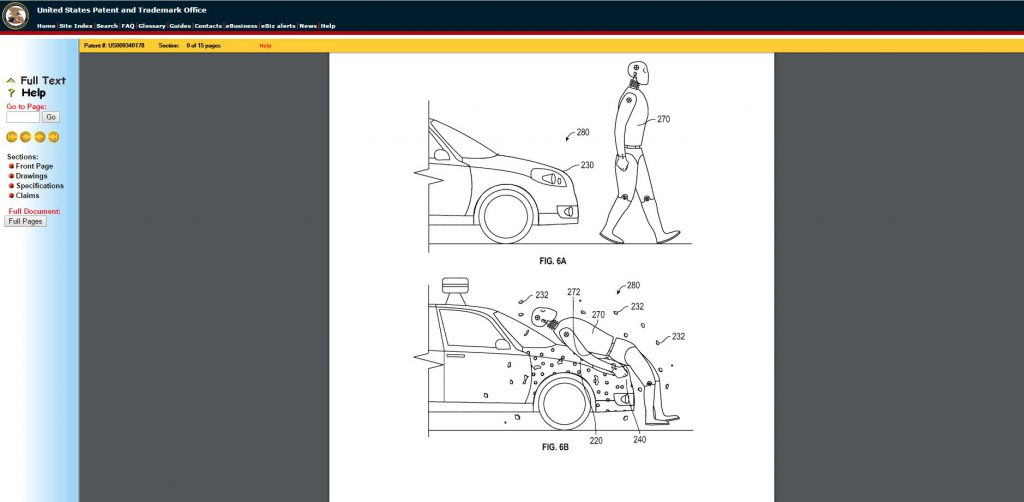

Pero ¿deberían estas máquinas y sistemas priorizar a los pasajeros o a los peatones externos?

Es una pregunta difícil porque, idealmente, estos medios de transporte deberían poder hacer ambas cosas bien y por igual. Sin embargo, un estudio de investigación reciente muestra que lo que la gente realmente quiere es viajar en un vehículo autónomo que priorice a sus pasajeros por encima de todo lo demás. En otras palabras, si este hipotético "cerebro" de máquina tiene que elegir entre chocar contra una pared o atropellar a alguien, bueno, lo siento, ya se entiende la idea.

¿Qué nos dijo el estudio?

La revista Science del mes pasado publicó un artículo interesante sobre un grupo de científicos informáticos y psicólogos que explicaban las seis encuestas en línea realizadas a residentes de Estados Unidos el año pasado entre junio y noviembre en las que se preguntaba a la gente cómo creían que deberían comportarse los vehículos autónomos. Los investigadores descubrieron que la mayoría de las personas incluidas en su muestra pensaban, en general, que los coches autónomos deberían estar programados para tomar decisiones en pro del "bien común".

Se trató de un estudio realizado a través de una serie de cuestionarios que presentaban opciones “desagradables” que equivalen a salvarse o sacrificarse uno mismo versus salvar las vidas de otros pasajeros que pueden ser miembros de la familia versus salvar a otros.

Al final, los investigadores descubrieron que la gente preferiría, por encima de todo, seguir viva.

Resulta especialmente revelador que este dilema de la “moralidad robótica” haya sido objeto de debate en los medios de ciencia ficción durante lo que parece una eternidad. Y ahora, en 2016, se ha convertido en una pregunta seria y habitual para los investigadores que trabajan en cosas como los vehículos autónomos, que deben, en esencia, programar “decisiones morales” en una máquina.

Como vehículos autónomos Y, como la inteligencia artificial se está desarrollando más que nunca, esto también se ha convertido en una cuestión filosófica con implicaciones comerciales: ¿deberían los fabricantes crear máquinas con diversos grados de moralidad programados en ellas (que dependerían de lo que quiera el consumidor)? ¿O debería el propio gobierno ordenar que todos los autos autónomos compartan el mismo valor de proteger algún tipo de bien mayor, incluso si no es tan bueno para los pasajeros del auto?

Preguntemos primero: ¿qué es exactamente el mayor bien?

"¿Es aceptable que un vehículo autónomo evite una motocicleta desviándose hacia una pared, considerando que la probabilidad de supervivencia es mayor para el pasajero del vehículo autónomo que para el conductor de la motocicleta? ¿Deben los vehículos autónomos tener en cuenta las edades de los pasajeros y de los peatones?” escribió Jean-François Bonnefon, de la Escuela de Economía de Toulouse en Francia.

Pensándolo bien, este debate se ha estado produciendo desde el “problema del tranvía”. Philippa Foot, una filósofa británica, introdujo esta idea en 1967:

“Imaginemos que un tranvía desbocado se dirige a toda velocidad hacia cinco trabajadores en las vías. Se podría salvar la vida de ellos con una palanca que cambiaría el tranvía a otra línea. Pero también hay un trabajador en esas vías. ¿Qué es lo correcto que hay que hacer?” (Enviado por correo electrónico)

Este es sólo el último paso en la deliberación sobre esa cuestión. Esta investigación ya está llevando a los fabricantes de vehículos autónomos por un agujero filosófico y legal y están más cerca que nunca de la fecha de lanzamiento. El concepto de vehículo autónomo es algo tan nuevo que, con toda probabilidad, llevará años encontrar respuestas definitivas. Pensemos en las ramificaciones legales: si un fabricante ofrece diferentes algoritmos morales y un comprador elige conscientemente uno de ellos sobre los demás, ¿es el comprador o el fabricante el culpable de las consecuencias perjudiciales de las decisiones de esa versión?

Actualmente, algunos investigadores sostienen que enseñar ética a las máquinas puede ser una forma equivocada de abordar este problema:

“Si asumimos que el propósito de la IA es reemplazar a las personas, entonces tendremos que enseñarle ética al automóvil”. dijo Amitai Etzioni, sociólogo de la Universidad George Washington. “Debería ser más bien una asociación entre el ser humano y la herramienta, y la persona debería ser quien proporcione orientación ética”. (Engadget).

Los autos autónomos están más cerca del público que nunca, especialmente porque las compañías planean lanzar programas piloto a fines de este año, 2016. Una cosa es segura: el transporte está cambiando, pero la pregunta es en qué se está transformando.

Alex ha trabajado en la industria de servicios automotrices durante más de 20 años. Luego de graduarse de una de las mejores escuelas técnicas del país, se desempeñó como técnico logrando la certificación de Maestro Técnico. También tiene experiencia como asesor de servicios y gerente de servicios. Leer más sobre alex